sprawdź czy punkt xi spełnia warunek stopu tzn. czy

,

jeśli tak to zakończ (xi jest rozwiązaniem)

,

jeśli tak to zakończ (xi jest rozwiązaniem)i := i + 1

gdzie

gdzie –

długość kroku minimalizująca jednowymiarową funkcje:

–

długość kroku minimalizująca jednowymiarową funkcje:

przejdź do pkt. 1

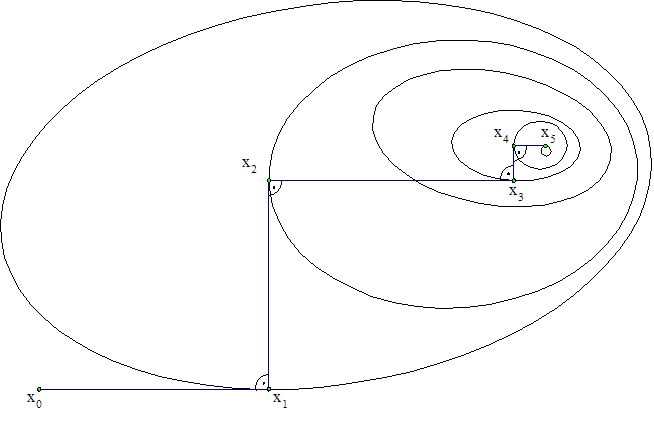

Metoda najszybszego spadku jest dość prostą gradientową, iteracyjną metodą optymalizacji bez ograniczeń. Każda iteracja polega na wykonaniu kroku w lokalnie najlepszym kierunku czyli w kierunku wyznaczonym przez ujemny gradient. Przy czym długość kroku może być stała (metoda gradientu prostego) lub wybrana tak by spadek wartości funkcji celu w nowym punkcie był jak największy (dobrana metodami optymalizacji jednowymiarowej).

x0 – pierwsze przybliżenie rozwiązania (punkt startowy)

xi – i-te przybliżenie rozwiązania

i – numer iteracji (na początku równa 0)

sprawdź

czy punkt xi spełnia warunek stopu tzn. czy![]() ,

jeśli tak to zakończ (xi jest rozwiązaniem)

,

jeśli tak to zakończ (xi jest rozwiązaniem)

i := i + 1

![]() gdzie

gdzie![]() –

długość kroku minimalizująca jednowymiarową funkcje:

–

długość kroku minimalizująca jednowymiarową funkcje:

![]()

przejdź do pkt. 1

Uwidoczniono poziomice dwuwymiarowej funkcji celu i kolejne punkty eksperymentów.